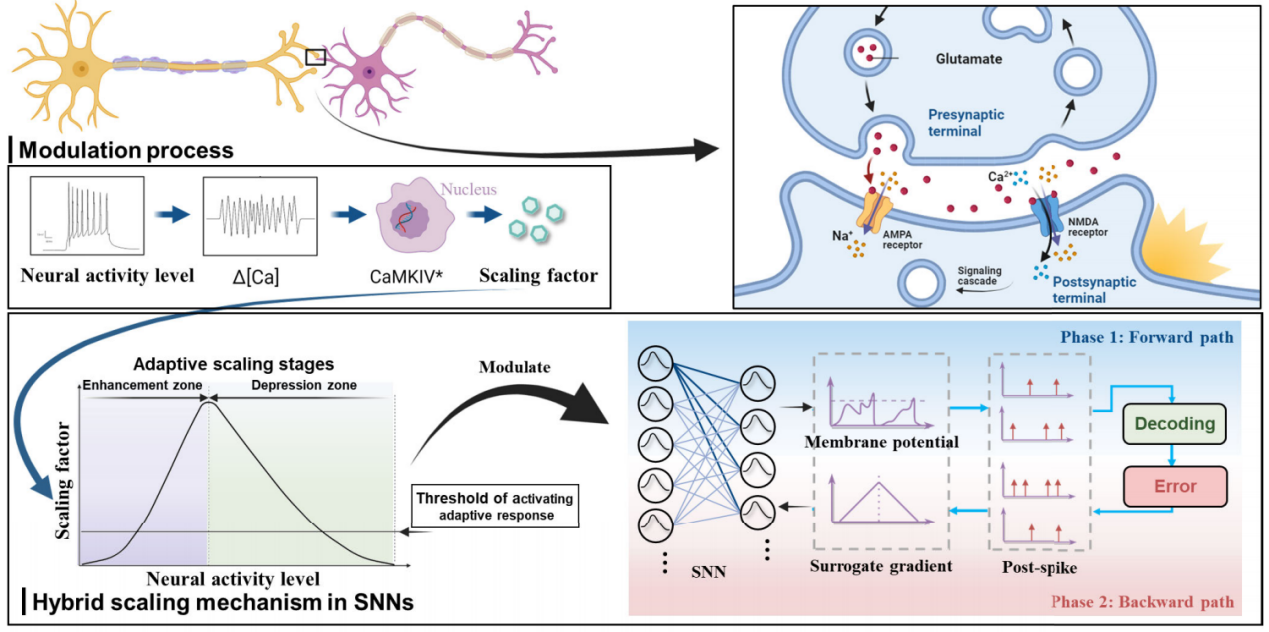

稳态突触可塑性(Homeostatic Synaptic Plasticity)是一组经验依赖的突触强度特定变化的可塑性机制,对于大脑学习和记忆具有重要作用。其通过动态调节突触强度来稳定神经元或回路活动。在细胞层面,研究表明,若单个神经元能够在特定时间内评估其活动强度,并据此动态向上或向下调整其突触权重,以使活动水平接近预定义的设定值,那么即使面临突触强度和连通性的变化,网络活动也将展现出稳定性。

同时,新皮层神经元发现突触缩放机制,作为稳态突触可塑性的一种表现形式,能够调整与神经元相关的所有突触的强度,通过倍数放缩保持激励间的相对强度差异。稳态突触缩放一般通过调节AMPA受体在突触处的传递或保留来调制连接强度。除了全局乘性调节,突触缩放还可以通过突触特异性过程触发,从而实现对突触强度的局部控制。

脉冲神经网络(SNN)被誉为第三代神经网络,具有丰富的时空动力学特性。在SNN中,神经元通过采用脉冲通信、事件驱动,仅对输入脉冲事件作出响应,具有高效的资源利用率。

尽管SNN侧重模拟生物神经特性,但大部分模型缺乏复杂的动力学特性和突触变化的自适应性,忽视了这种缩放机制的作用,这限制了SNN的学习效率和潜在应用。将稳态突触缩放机制有效整合到SNN的学习范式中,仍是一个具有挑战性的问题。尽管一些研究将该机制融入SNN,通过强约束引导网络活动趋近于设定点,但限制了学习的灵活性。近年来,基于梯度学习的方法在SNN中广泛应用,实现了更高的性能。然而,突触权重在每个训练周期中是静态的,这使得SNN在受到扰动或连续性场景中表现脆弱。因而在抗扰动性和持续学习等任务中表现不佳。

广东省智能院类脑计算理论与器件研究团队徐明坤博士与清华大学类脑计算研究中心的刘发强博士为本文共同第一作者。该工作得到了广东省重点领域研发计划、科技创新2030-新一代人工智能、国家自然科学基金等项目的资助。

文章连接:

https://ieeexplore.ieee.org/abstract/document/10479209